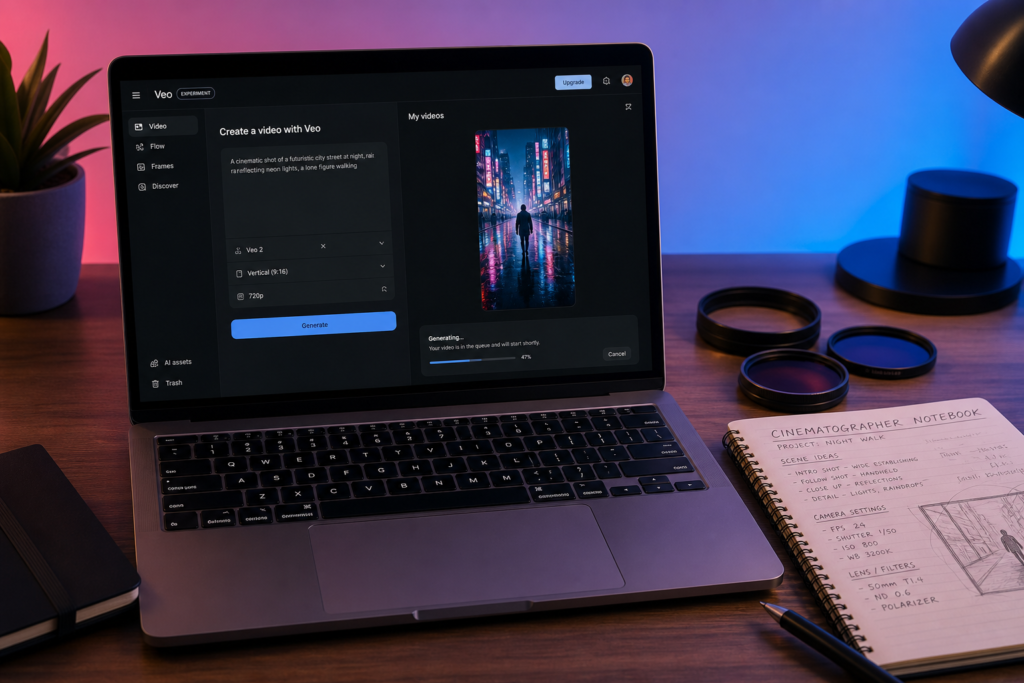

13 stycznia 2026 Google DeepMind wypuściło Veo 3.1 — odpowiedź na Sora 2. Dla polskich filmowców to ważna data, bo Veo jest dostępne w Gemini bez geo-blokady (Sora 2 wciąż wymaga obejścia regionalnego dla części funkcji).

Co nowego w Veo 3.1

- Pionowe 9:16 dla YouTube Shorts, Reels, TikTok — bezpośrednio z modelu, bez croppingu

- Upscaling do 1080p i 4K wbudowany — bez Topaza w pipeline’ie

- Ingredients to Video — łączenie kilku reference images w jednym prompcie z lepszą kontrolą sceny

- Native audio — synchroniczny dźwięk i muzyka w jednym przebiegu

- Realistyczna fizyka — szczególnie mocne w naturze (woda, ogień, tkaniny)

Sora 2 vs Veo 3.1 — które kiedy

Z perspektywy studia AMA AI Film oba modele mają konkretne use case’y:

- Sora 2 — dłuższe ujęcia (do 25s), Cameo (postaci), bardziej kinematograficzny styl, lepszy dla short story i shortów reklamowych

- Veo 3.1 — pionowe formaty social, najlepszy do nature footage, szybszy w generacji, mocniejsza spójność z reference images

- Runway Gen-4 — motion brushes, scene consistency między ujęciami, do bardziej narracyjnych projektów

- Kling 2.6 — short-form, viralowy content, długie ujęcia chińskiej szkoły wizualnej

Pipeline hybrydowy

W praktyce żaden model sam nie wystarczy. Profesjonalny pipeline AI w 2026 to kombinacja 3-4 modeli + ComfyUI dla lokalnej kontroli + post-produkcja w klasycznym DaVinci Resolve / Premiere. Freepik AI Suite agreguje większość tych modeli pod jedną subskrypcją — to często wystarcza do start-upu i shortów.

Co testujemy w AMA

W ramach One Movie Project AI 25/26 studenci dostają dostęp do wszystkich tych modeli i porównują wyniki. Nasza obserwacja: Veo 3.1 wygrywa na pionowym social, Sora 2 dla kinematograficznych ujęć, a klucz to umiejętność doboru narzędzia do zadania, nie wybór „najlepszego” modelu.

Dlatego w AMA Film Academy uczymy workflow hybrydowych, nie pojedynczych narzędzi. Modele zmienią się w 6 miesięcy. Warsztat reżyserski, prompt engineering filmowy, kontrola kompozycji i światła — zostaną.